3D-Körperposenerkennung

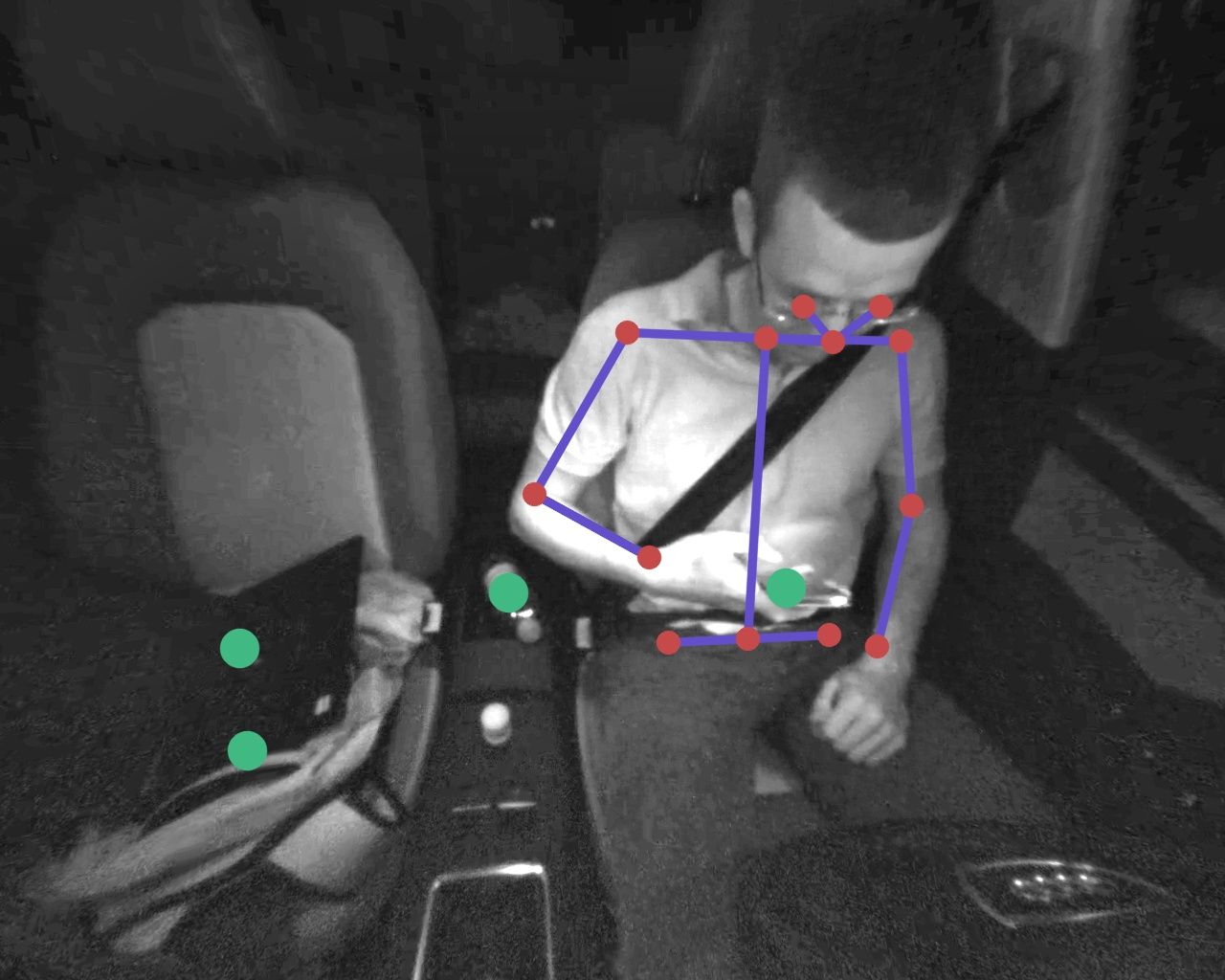

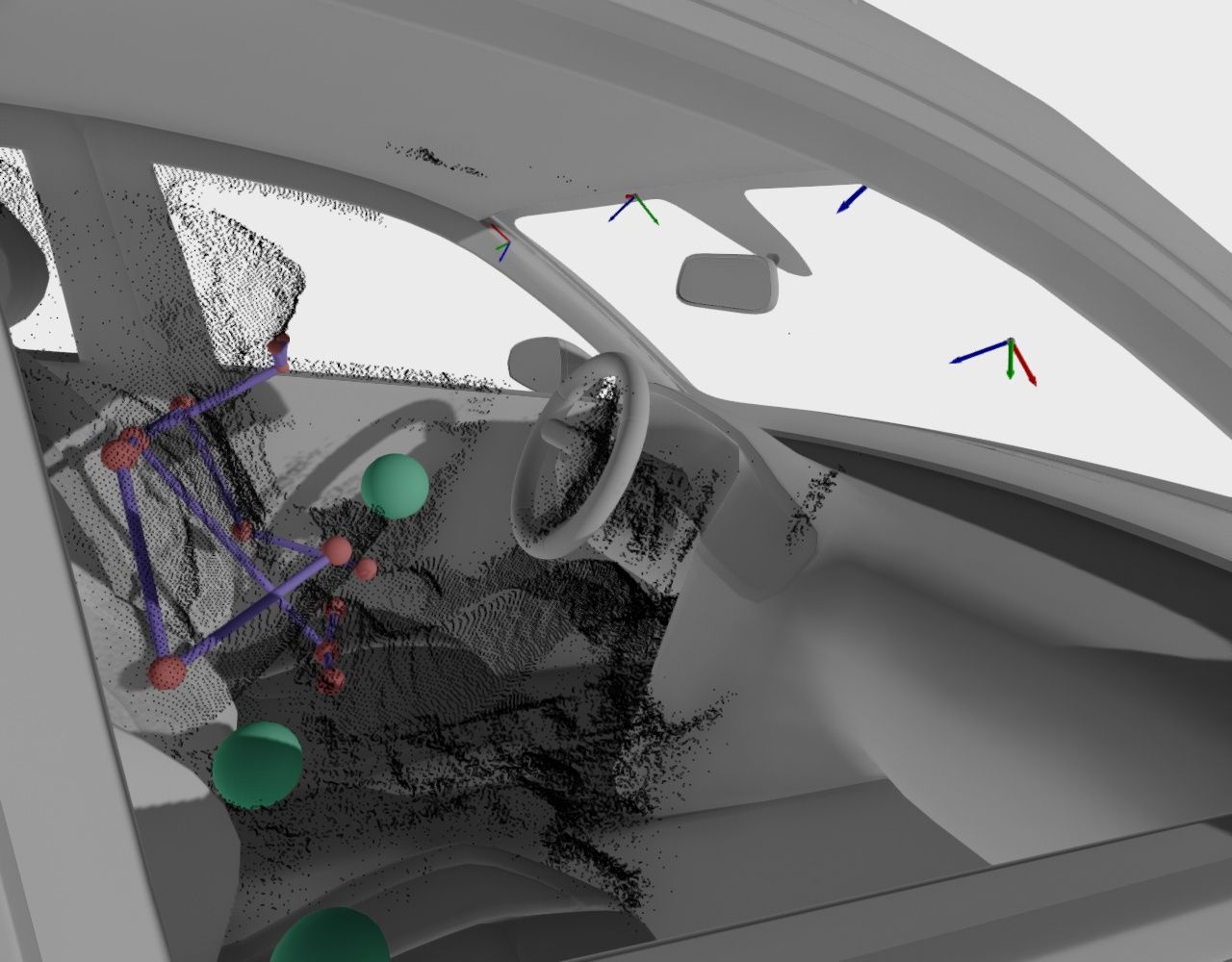

Grundlage des Advanced Occupant Monitoring Systems bildet die Echtzeit-Erfassung der Körperpose in 3D. Für alle Fahrzeuginsassen, die von Kameras erfasst werden, wird die Körperhaltung mit Hilfe maschineller Lernverfahren als 3D-Skelettmodell erkannt. Das resultierende Abbild der erfassten Insassen umfasst die Position der Augen und des Kopfes, des Nackens, der Schultern, Ellbogen, Handgelenke, Torso, Becken sowie Ober- und Unterschenkel – sobald diese im Kamerabild sichtbar sind. Die Erfassung kommt ohne biometrische Daten aus und ist damit besonders datenschutzfreundlich.

Das System ist in der Lage, einzelne 3D-Kameras zu nutzen oder mehrere 2D-Kameras, aus deren Perspektiven die 3D-Gelenkpunkte rekonstruiert werden. Die Anbringung der Kameras kann dabei beliebig erfolgen, solange die Sicht auf die jeweiligen Personen ausreichend gegeben ist.

Gestenerkennung

Aus dem ermittelten Körperposenskelett gehen auch die Positionen der Augen, der Ellbogen sowie der Handgelenke hervor. Damit ist es möglich, sowohl die Richtung des Unterarms als auch die Zeigerichtung der Auge-Hand-Verlängerung als Zeigegeste zu interpretieren. Beide Varianten liegen als 3D-Vektor vor. Zeigegesten können daher unmittelbar und zentimetergenau auf bekannte Objekte im Fahrzeuginnenraum oder im Außenraum des Fahrzeugs abgebildet werden. Da die Zeigegestenerfassung auf der 3D-Körperposenerkennung aufbaut, können zudem linke von rechten Armen unterschieden und Zeigegesten überall im Innenraum erkannt werden – nicht nur an konventionellen Sitzpositionen oder in vorgeschriebenen Interaktionsbereichen.

Gestenerkennung zur Interaktion mit (teil-)automatisierten Fahrzeugen

Es ist zu erwarten, dass dem Fahrer und den anderen Insassen mit zunehmender Automatisierung des Fahrzeugs auch mehr Freiheiten für Nebenaktivitäten erlaubt und im Innenraum angeboten werden. Konzeptfahrzeuge brechen bereits heute mit der klassischen Sitzanordnung und vergrößern den Bewegungs- und Handlungsbereich z.B. des Fahrers auf den gesamten Innenraum, indem Sitze gedreht und bewegt werden können. Vor dem Hintergrund einer solchen Bewegungsfreiheit stellt sich die Frage, wie die Interaktion mit Diensten im Innenraum realisiert werden soll. Zeigegesten und Spracheingabe bieten sich an, müssen jedoch sowohl die nötige Robustheit und Freiheit bieten, um Insassen den Handlungsspielraum im Innenraum einräumen zu können.

Im Gegensatz zu konventionellen Driver Monitoring Systemen ist das Advanced Occupant Monitoring System des Fraunhofer IOSB in der Lage, Freiraumgesten in 3D aller Insassen zu erkennen und auszuwerten.

Aktivitätserkennung im Fahrzeuginnenraum

In manuellen Fahrtsituationen richtet der Fahrer idealerweise seine volle Aufmerksamkeit auf die Straße. Er fährt und steuert das Auto und geht keiner Nebenaktivität nach. Mit zunehmendem Grad der Fahrzeugautomatisierung wird der Fahrer jedoch von seiner Fahrverantwortung befreit. Er erhält die Freiheit, Nebenaktivitäten nachzugehen. Teilautomatisierte Fahrzeuge müssen diese Gegebenheit berücksichtigen, wenn mit Situationen umgegangen werden muss, in denen die Fahrverantwortung zurück an den Fahrer übergeben werden soll. Möglicherweise ist der Fahrer abgelenkt, schläft oder hat sogar einen medizinischen Notfall.

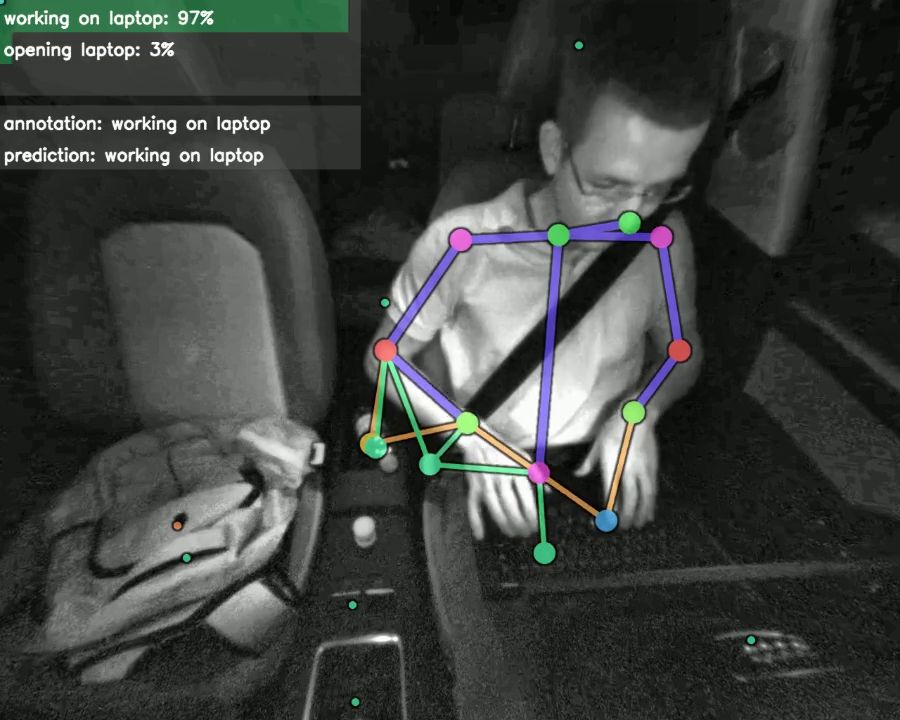

Das Advanced Occupant Monitoring System des Fraunhofer IOSB erkennt die Aktivität aller Insassen im Fahrzeuginnenraum. Es ist in der Lage, zwischen bis zu 35 Aktivitäten zu unterscheiden, darunter u.a. Trinken, Essen, Schlafen, Lesen, Telefonieren uvm. Modernste maschinelle Lernverfahren verarbeiten und fusionieren hierzu die 3D-Körperskeletterkennung der Insassen in Kombination mit einer Objekterfassung und intelligenten Analyse des Bewegungsverhaltens aller erfassten Personen. Damit kann zuverlässig unterschieden werden, ob zum Handy gegriffen und telefoniert oder eine Flasche geöffnet und an den Mund geführt wird. Während bisherige Driver Monitoring Systeme lediglich Aussagen zur Anwesenheit und Müdigkeit des Fahrers liefern, bietet unser Advanced Occupant Monitoring System sogar wichtige Informationen zum Ablenkungszustand des Fahrers. Darüber hinaus liefert unser System aber auch wichtige Informationen zur vorherrschenden Situation im Fahrzeuginnenraum und zum Handlungskontext einer Person. Dadurch können beispielsweise unbeabsichtigte von beabsichtigten Zeigegesten unterschieden oder innovative Assistenzfunktionen auf individuelle Bedarfe der Insassen zugeschnitten angeboten werden.

Intentionserkennung des Fahrers und der Fahrzeuginsassen

Die Aktivitätserkennung bildet die Grundlage, um die Intention des Fahrers oder der Fahrzeuginsassen vorhersagen zu können. Weil durch die Aktivitätserkennung des Fahrers bekannt ist, womit bzw. mit wem sich der Fahrer beschäftigt, können die nächsten Aktionen des Fahrers vorhergesagt bzw. eingegrenzt werden.

Fraunhofer-Institut für Optronik, Systemtechnik und Bildauswertung IOSB

Fraunhofer-Institut für Optronik, Systemtechnik und Bildauswertung IOSB