Gruppenbeschreibung

Gegenstand der Arbeiten ist die Erkennung und Übergabe von Objekten in den bildhaften Daten vernetzter, mobiler Sensoren. Die untersuchten Technologien reichen dabei von der ansichtenunabhängigen Objektbeschreibung über die Registrierung von Sensorbildern in dreidimensionale Kontextdaten bis hin zur bandbreitensparenden Übertragung der Objektinformationen.

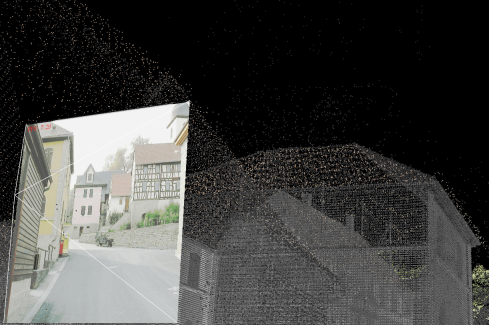

- Bildbasierte Objektlokalisierung mittels multi-modaler Bilddatenfusion

Das Ziel des Projekts ist ein generisches Verfahren zur dreidimensionalen Objektlokalisierung, welches auf im Vorfeld aufgenommene 3D-Daten zurückgreifen kann. - Videobasierte Echtzeit-3D-Rekonstruktion

Es werden Verfahren zur Ableitung von Informationen über die Kameratrajektorie und Struktur der Szene aus Videos untersucht, die sich zur echtzeitfähigen Kartenerstellung, Augmented Reality oder in Verbindung mit autonomen Fahr- und Flugzeugen nutzen lassen. - Rekonstruktion bewegter Objekte in Monokularen Videodaten

Dieses Projekt beschäftigt sich mit der Rekonstruktion der dreidimensionalen Form bewegter Objekte in monokularen Videodaten durch Nutzung semantischer Bildinformationen. - Rekonstruktion dreidimensionaler Fahrzeugtrajektorien in Monokularen Videodaten

Die Bestimmung konsistenter Objekttrajektorien in monokularen Videodaten erfordert zusätzliche Einschränkungen der Bewegung. Geeignete Nebenbedingungen werden im Rahmen dieses Projektes näher analysiert und evaluiert. - Lokalisierung mobiler Endgeräte durch Fusionierung von mobilen Sensordaten

In vielen Anwendungen ist die genaue Lokalisierung von Personen oder Gegenständen ein entscheidender Faktor. In der heutigen Zeit bieten mobile Plattformen wie Smartphones oder Tablets genug Leistung, Sensoren und Konnektivität, um als mobile Messstation eingesetzt zu werden. - Visualisierung georeferenzierter Objekte auf mobilen Endgeräten

Die geeignete Visualisierung von zusätzlichen Informationen im Sichtbereich von Benutzern ist immer noch eine herausfordernde Aufgabe. Ziel des Projekts ist die Entwicklung von flexiblen mobilen Applikationen zur Visualisierung von georeferenzierten Objektdaten auf mobilen Endgeräten. - Nutzung von Virtual Reality Verfahren in Kombination mit Kamerasensorik

Die Darstellung und Nutzung verschiedenster Kamerasensorik in Kombination mit einer Virtual Reality Brille ist das Ziel dieses Projekts. Hierbei werden sowohl Augmented Reality Verfahren als auch die Interaktionsmöglichkeiten der Virtual Reality Brille miteinbezogen. - Bildbasierte Ortserkennung

Bildbasierte Ortserkennung findet anhand des visuellen Inhalts eines Eingabebildes den Ort, an dem dieses Bild aufgenommen wurde. Dieses Verfahren kann z.B. für bildbasierte Navigation, für die Georeferenzierung von Bildern oder zur Schleifenschlussdetektion in VSLAM-Systemen verwendet werden. - Technologieträger MODISSA

Beim Technologieträger MODISSA (engl. Mobile Distributed Situation Awareness) handelt es sich um die IOSB-eigene Realisierung einer Experimentierplattform zur Sensorbewertung und Verfahrensentwicklung im Zusammenhang mit Aufgabenstellungen und Rahmenbedingungen von Fahrzeugschutz und fahrzeugbezogener Sicherheit, auch bei militärischen Anwendungen.

Fraunhofer-Institut für Optronik, Systemtechnik und Bildauswertung IOSB

Fraunhofer-Institut für Optronik, Systemtechnik und Bildauswertung IOSB